一张截图流出:基金委已接入大模型,AI 写基金,必查必通报?

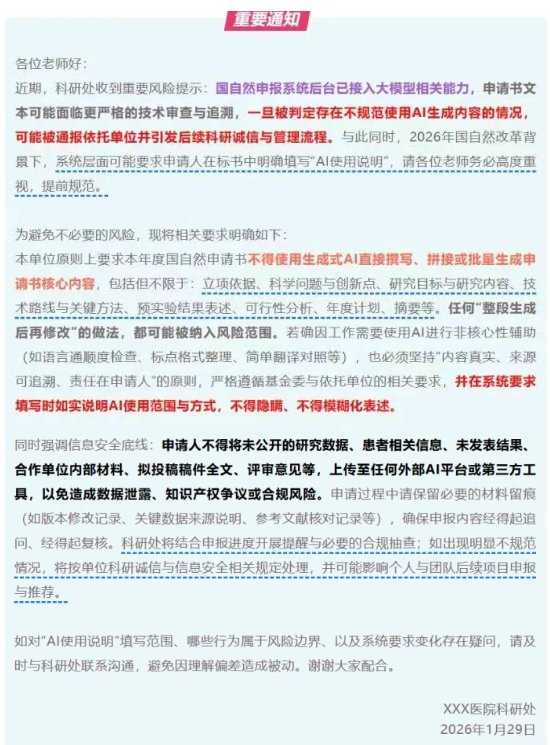

最近网上流传了一张截图,具体内容是某单位发布了新通知,说国自然申报系统后台疑似已接入大模型相关能力,一旦被判定存在不规范使用AI生成内容的情况,可能被通报依托单位并引发后续科研诚信与管理流程。

图源:网络

“AI写的本子一定会查出来还会通报”,真能查?查到什么程度?靠什么标准?说白了,“AI查重”那套逻辑:最后往往不是抓住了“造假的人”,而是折腾了“认真写的人”。更何况现在的AI痕迹这件事,本身就很玄:同样一句话,有人觉得“像AI”,有人觉得“就是书面语”;有的老师写作本来就规整,反而更容易被怀疑。

于是争论就来了:如果所谓“检测”是黑箱,阈值不公开、规则不解释、误伤也没说法,那它就不只是技术工具,而是一种管理姿态——一句“能查出来”可以让所有人自我审查、人人心里发毛。反过来讲,如果基金委确实要求写“AI使用说明”,那也说明它至少在制度层面默认“有人会用”,重点可能是“你用到哪里、有没有负责、有没有违规”。所以“能不能查出来”这事,最后很可能不是算力多强的问题,而是“要不要抓、抓谁、抓到什么程度”的问题。

2026 年国自然申报系统确实有调整方向,系统中会新增AI 使用相关填写模块,要求申请人对 AI 使用情况进行如实说明,这一导向是明确的。基金委的核心态度并非禁止AI 工具,而是要求使用透明、责任到人。

这并非禁止使用AI工具,而是划定了“人是第一责任人” 的绝对红线。其主要目的是防范因AI工具的“幻觉”现象导致申请书中出现无意识的不实内容。它警示所有申请人:技术是助手,诚信是基石,任何工具都不能成为学术表述失实的借口。这些内容关乎标书核心价值,是评审重点,使用AI必须详细标注,模糊表述即踩红线。

-

立论依据综述与逻辑梳理

用AI(如ChatGPT、Consensus)检索文献、梳理研究脉络或知识缺口,需说明使用方式及人工核实过程。示例:“在‘国内外研究现状’部分,使用ChatGPT-4对近五年‘肠神经胶质细胞调控肝纤维化’文献摘要聚类,生成初步框架;申请人精读核心文献后核实重写核心观点。”

-

研究假说与创新点提炼

用AI辅助凝练、优化创新点表述,需披露。示例:“在‘项目创新之处’,使用文心一言优化3个初步创新点的表述逻辑;最终内容由申请人确定并经团队论证。”

-

技术路线与实验方案设计

用AI生成或优化实验步骤、试剂配方,需说明参与范围及验证过程。示例:“‘免疫荧光染色方案’中,用ChatGPT-4获取多色抗体组合优化建议;申请人查阅文献并通过预实验验证,确定最终方案。”

-

机制示意图绘制

用AI(如DALL·E 3)生成图表初稿,需声明使用及人工修正过程。示例:“图2机制示意图初版由DALL·E 3生成;申请人用Adobe Illustrator重绘,修正科学错误并补充细节,经专家审核确认。”

目前市面上所有 AI 文本检测手段,都做不到百分百精准识别。技术层面多依靠文本特征、句式逻辑、词汇分布做判断,专业科研文本本身就具备严谨、规整、逻辑清晰的特点,和AI 生成内容的特征存在天然重叠。长期规范写作的科研人员,文本反而容易被系统标记为高风险,经过深度人工修改的 AI 内容,检测难度会大幅提升。所谓接入特定大模型端口实现溯源识别,现阶段不具备普遍落地的技术条件,也无官方落地信息。

基金委和依托单位关注的重点,从来不是有没有点开过AI 工具,而是使用方式是否越过科研诚信底线。直接用 AI 生成立项依据、创新点、研究内容、技术路线等核心板块,整段复制拼接后简单修改,属于明确的高风险行为。用 AI 做语言通顺调整、标点格式整理、简单文献翻译对照,这类辅助性操作本身不构成违规。

因此,申请人在使用AI工具时,需始终保持警惕,明确区分哪些操作属于合理辅助,哪些可能触及红线。科研活动本质上是人类智慧的结晶,任何技术手段都应服务于这一核心目标,而非替代或扭曲它。基金委的态度表明,透明度和责任感是关键,申请人必须清楚记录AI参与的具体环节,并对其结果进行充分验证和修正。

赞一个

- 文章标签:

- 高校动态

-

IEEE出版|第二届先进能源系统与电力电子国际学术会议(AESPE 2026)

IEEE出版|第二届先进能源系统与电力电子国际学术会议(AESPE 2026) -

SPIE出版| 2026年机器视觉、检测与三维成像技术国际学术会议(MVDIT 2026)

SPIE出版| 2026年机器视觉、检测与三维成像技术国际学术会议(MVDIT 2026) -

IOP-JPCS出版 | 2026年智能制造及测控技术国际学术会议(IMMCT 2026)

IOP-JPCS出版 | 2026年智能制造及测控技术国际学术会议(IMMCT 2026) -

2026年低碳能源与智能电网学术会议(LCESG 2026)

2026年低碳能源与智能电网学术会议(LCESG 2026) -

IEEE出版|2026年电子电路与传感器技术国际学术会议(ECST 2026)

IEEE出版|2026年电子电路与传感器技术国际学术会议(ECST 2026) -

第七届机械工程、智能制造与机电一体化学术会议(MEIMM2026)

第七届机械工程、智能制造与机电一体化学术会议(MEIMM2026) -

IOP-JPCS出版 | 2026年内燃机技术与能源动力工程国际学术会议(ICTEPE 2026)

IOP-JPCS出版 | 2026年内燃机技术与能源动力工程国际学术会议(ICTEPE 2026) -

IEEE出版|第二届通信网络与智能系统工程国际会议(ICCNSE 2026)

IEEE出版|第二届通信网络与智能系统工程国际会议(ICCNSE 2026)

更有众多热门